Álgebra lineal con aplicaciones

2. Álgebra de matrices

Contenido

2.1 Suma, multiplicación escalar y transposición de matrices

2.2 Multiplicación Matriz-Vector

2.5 Matrices elementales

2.6 Transformaciones lineales

2.7 LU-Factorization

2.8 Una aplicación a los modelos económicos input-output

2.9 Una aplicación a las cadenas de Markov

Después de una mirada tradicional a la suma de matrices, la multiplicación escalar y la transposición en la Sección 2.1, la multiplicación de matrices y vectores se introduce en la Sección 2.2 al ver el lado izquierdo de un sistema de ecuaciones lineales como el producto Ax de la matriz de coeficientes A con la columna x de variables. A continuación se muestra la definición habitual de producto escalar de una multiplicación matriz-vector. La sección 2.2 termina viendo una matriz A de tamaño m × n como una transformación Rn → Rm. Esto se ilustra para R2 → R2 al describir la reflexión en el eje x, la rotación de R2 a través de π/2, etc.

En la sección 2.3, el producto de las matrices A y B se define por AB = [Ab1 Ab2 ··· Abn], donde las bi son las columnas de B. Un cálculo de rutina muestra que esta es la matriz de la transformación B seguida de A. Esta observación se usa con frecuencia en todo el libro y conduce a demostraciones conceptuales simples de los axiomas básicos del álgebra matricial. Tenga en cuenta que no se requiere linealidad; todo lo que se necesita son algunas propiedades básicas de la multiplicación matriz-vector desarrolladas en la Sección 2.2. Así, la definición arcana habitual de la multiplicación de matrices se divide en dos partes bien motivadas, cada una de las cuales es un aspecto importante del álgebra de matrices. Por supuesto, esto tiene la ventaja pedagógica de que se puede invocar el poder conceptual de la geometría para iluminar y aclarar las técnicas y definiciones algebraicas.

En las secciones 2.4 y 2.5 se caracterizan las inversas de la matriz, se explora su significado geométrico y se introduce la multiplicación de bloques, enfatizando los casos necesarios más adelante en el libro. Se discuten las matrices elementales y se deriva la forma normal de Smith. Luego, en la Sección 2.6, transformaciones lineales Rn → Rm se definen y se muestran como transformaciones matriciales. Se determinan las matrices de reflexiones, rotaciones y proyecciones en el plano. Finalmente, la multiplicación de matrices se relaciona con gráficas dirigidas, se introduce la factorización LU de matrices y se presentan aplicaciones a modelos económicos y cadenas de Markov.

En el estudio de sistemas de ecuaciones lineales en el Capítulo 1, encontramos conveniente manipular la matriz aumentada del sistema. Nuestro objetivo era reducirlo a la forma escalonada de fila (usando operaciones de fila elementales) y, por lo tanto, anotar todas las soluciones para el sistema. En el presente capítulo consideramos matrices por su propia utilidad. Si bien parte de la motivación proviene de ecuaciones lineales, resulta que las matrices se pueden multiplicar y sumar y formar un sistema algebraico, algo análogo a los números reales.

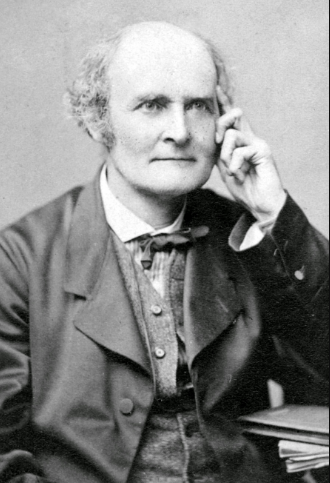

Este “álgebra matricial” es útil en formas que son bastante diferentes del estudio de ecuaciones lineales; por ejemplo, las transformaciones geométricas obtenidas al rotar el plano euclídeo sobre el origen puede ser visto como multiplicaciones por ciertas matrices 2 × 2. Estas “transformaciones matriciales” son una herramienta importante en geometría y, a su vez, la geometría proporciona una “imagen” de las matrices. Además, el álgebra matricial tiene muchas otras aplicaciones, algunas de las cuales serán exploradas en este capítulo. Este tema es bastante antiguo y fue estudiado sistemáticamente en 1858 por Arthur Cayley.

Arthur Cayley (1821-1895) mostró su talento matemático en edad temprana y se graduó en Cambridge en 1842. Sin ningún empleo en matemáticas a la vista, recibió capacitación legal y trabajó como abogado mientras continuaba haciendo matemáticas, publicando casi 300 artículos en catorce años. Finalmente, en 1863, aceptó la cátedra sadleriana en Cambridge y permaneció allí por el resto de su vida, valorado por sus habilidades administrativas y de enseñanza, así como por su beca. Sus logros matemáticos fueron de primer rango. Además de su teoría original de matrices y la teoría de los determinantes, realizó un trabajo fundamental en la teoría de grupos, en la geometría de dimensiones superiores y en la teoría de los invariantes. Fue uno de los matemáticos más prolíficos de todos los tiempos y produjo 966 artículos.